Artículos

22 de enero de 2024

La IA Act: El primer marco normativo vinculante de la Inteligencia Artificial

La sociedad en general aún está a la incertidumbre de los efectos de la “Ley De Inteligencia Artificial”. Algunos la miran con ojos de optimismo por representar una oportunidad de fomento a la innovación y la confianza en las nuevas tecnologías. Sin embargo, otros la critican por ser restrictiva o muy ambigua. Lo cierto es que es revolucionaria al ser la primera en su especie.

Por: Valeria Alejandra Barrera Moreno – Auxiliar de investigación del Departamento de Derecho de las Telecomunicaciones e Informático.

INTRODUCCIÓN

Aunque la Inteligencia Artificial (IA) comenzó a dar sus primeros pasos en 1943, cuando Warren y Walter publicaron el artículo «A Logical Calculus of Ideas Immanent in Neurons Activity», donde presentaron la fórmula para crear una red neuronal artificial mediante un modelo matemático[1]. Fue hasta el 2022, con el lanzamiento del sistema ChatGPT de OpenAI, que se popularizó esta herramienta para el público en general[2]. Con este nuevo panorama la sociedad y las personas comenzaron a cuestionar los beneficios o los problemas que la IA podría representar para la humanidad.

En vista de que la IA figura como “un conjunto de tecnologías de rápida evolución que puede generar un amplio abanico de beneficios económicos y sociales en todos los sectores y las actividades sociales”[3]. También tiene la capacidad de representar nuevos riesgos y crear situaciones adversas para las personas, ya sea como individuo o en comunidad. Es decir, la IA como cualquier otra tecnología está al servicio de la humanidad y, dependerá del nivel ético del individuo y su sociedad el uso que se le dará a la misma, repercutiendo en algo positivo o negativo.

Por ello, diferentes organismos internacionales se pusieron en la tarea de expedir reglamentaciones como la “Recomendación sobre la IA” en 2019 de la Organización para la Cooperación y el Desarrollo Económicos (OCDE) o la “Recomendación sobre la ética de la IA” en 2021 por la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO). La cuestión es que eran normativas no vinculantes para los Estados, motivo por el que la Unión Europea (UE) decidió ser la pionera en la regulación de la IA. La primera aproximación fue en octubre del 2020 cuando el Parlamento Europeo publicó un paquete de recomendaciones normativas dirigida a la Comisión Europea, entre ellas está el marco ético de la IA, la robótica y las tecnologías conexas[4]. Posteriormente, la Comisión Europea puso en marcha la expedición de un marco regulatorio, la “IA Act”.

La “Ley De Inteligencia Artificial” presentada por la Comisión Europea el 21 de abril del 2021, pretende desarrollar un ecosistema de confianza en la IA, con un marco jurídico destinado a que sus usos sean fiables para los ciudadanos y usuarios. Motivo por el cual, la propuesta se centra en los valores y derechos fundamentales de las personas, en consonancia con los siguientes objetivos:

“1. Garantizar que los sistemas de IA introducidos y usados en el mercado de la UE sean seguros y respeten la legislación vigente en materia de derechos fundamentales y valores de la Unión;

2. Garantizar la seguridad jurídica para facilitar la inversión e innovación en IA;

3. Mejorar la gobernanza y la aplicación efectiva de la legislación vigente (…);

4. Facilitar el desarrollo de un mercado único para hacer un uso legal, seguro y fiable de las aplicaciones de IA y evitar la fragmentación del mercado”[5].

Por esto, la estructura de la IA Act tiene un enfoque normativo horizontal, equilibrado, subsidiario y proporcionado, limitado a establecer requisitos mínimos sin afectar el desarrollo tecnológico de la industria. El marco regulatorio pretende centrarse en las situaciones sobre las que se tienen preocupaciones justificadas o razonadas de la configuración de situaciones problemáticas en un futuro próximo. Para así, poder establecer el correcto funcionamiento del mercado entorno del uso de los productos y servicios de la IA.

LA PROPUESTA “IA ACT”

En principio, se propone una serie de definiciones jurídicas necesarias para darle mayor claridad a la regulación. La primera definición es la de Sistema de Inteligencia Artificial y, se complementa con el Anexo I que contiene una lista de estrategias y técnicas para su desarrollo. Así: “El software que se desarrolla empleando una o varias de las técnicas y estrategias que figuran en el anexo I y que puede, para un conjunto determinado de objetivos definidos por seres humanos, generar información de salida como contenidos, predicciones, recomendaciones o decisiones que influyan en los entornos con los que interactúa”. Es una definición neutra y amplia para ser adaptable a situaciones futuras, habida cuenta de la rápida evolución tecnológica. Así mismo, comprende los sistemas de IA que pueden usarse de forma independiente o como componente de un producto. En concordancia al principio de neutralidad tecnológica que debe primar al regular fenómenos tecnológicos.

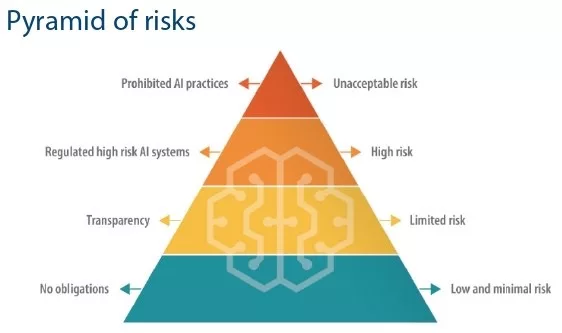

En los Títulos II, III, IV de la IA Act, se clasifican los sistemas de IA conforme al riesgo que cada uno representa frente a la seguridad y los derechos fundamentales. Ellos se establecen dependiendo de las características como la complejidad, la dependencia de los datos, el comportamiento autónomo de cada sistema. Así que se distingue entre: (i) un riesgo inaceptable, (ii) un riesgo alto (iii) un riesgo limitado y, (iv) un riesgo bajo o mínimo.

Figura 1: pirámide de los riesgos. – sacada del documento “Artificial intelligence Act” publicado en junio del 2023, diseñado por Samy Chahri.

Se determinan como sistemas de riesgo inaceptables aquellos que entran en conflicto con los valores fundamentales de la Unión, como la violación de los derechos humanos. Con este propósito, se ha elaborado una lista de prácticas prohibidas que incluye ciertas técnicas, como aquellas que tienen el potencial de manipular a las personas o explotar a los grupos vulnerables. Asimismo, se ha prohibido expresamente que las autoridades realicen una clasificación social basada en la IA o utilicen sistemas de identificación biométrica remota en tiempo real en espacios de acceso público con fines legales, a menos que sea estrictamente necesario, entre otras disposiciones.

Los sistemas que pueden afectar la salud y la seguridad de las personas físicas se clasifican como de alto riesgo. Se ha elaborado una lista específica de estos sistemas en el Anexo III del documento, los cuales pueden ser comercializados en el mercado europeo siempre que cumplan con ciertos requisitos legales, como la protección de datos personales, la transparencia, la vigilancia humana y la seguridad. Además, deben someterse a una evaluación de conformidad previa, un seguimiento posterior y registrarse en una base de datos independiente de la UE para sistemas de alto riesgo, gestionada por la Comisión Europea. Estos sistemas se subclasifican según su uso:

- Sistemas de IA diseñados para formar parte de la seguridad de productos que están sujetos a una evaluación de conformidad previa realizada por terceros.

- Otros sistemas de IA independientes que tienen implicaciones relacionadas con los derechos fundamentales.

La lista del Anexo III puede ser ampliada por la comisión, mediante la aplicación de criterios y una metodología de evaluación del riesgo. De modo que se puedan definir potenciales nuevos usos y aplicaciones de la IA. Las soluciones para lograr el cumplimiento de los requisitos pueden proceder de especificaciones técnicas o con arreglo a los conocimientos científicos o de ingeniería a discreción del proveedor.

Por otro lado, se imponen un conjunto de obligaciones horizontales a los proveedores, usuarios y otros participantes de la cadena de valor de la IA de alto riesgo. Como también, se establecen procedimientos de evaluación de conformidad para reducir la carga que deben soportar los operadores económicos.

Los sistemas de riesgo limitado son aquellos a los que se les imponen obligaciones de transparencia y que interactúan con los seres humanos. Por ejemplo, situaciones en que los proveedores de sistemas destinados a interactuar con personas físicas, estén diseñados de tal forma que las personas entiendan que están interactuando con la IA; los usuarios de sistemas de reconocimiento de emociones o sistemas de categorización biométrica informaran del funcionamiento del sistema a las personas expuestas; o que, los usuarios de sistemas de IA que manipulen contenido de imagen, video o sonido que se asemeje a personas, objetos, lugares u otras entidades, harán público que el contenido ha sido generado de forma artificial o manipulado; entre otros. Los sistemas de riesgo bajo o mínimo son los restantes, aquellos que no se encuentran en las anteriores clasificaciones y que en principio no se les impone mayores obligaciones o limitaciones. Simplemente se prevé la creación de códigos de conducta para alentar a los proveedores de sistemas de IA que no sean de apto riesgo y sean aplicados voluntariamente.

Para finalizar este acápite, la ley reglamentó las medidas en favor de la innovación con el fin de fortalecer su resistencia al paso del tiempo por futuras perturbaciones. Crea un sistema de gobernanzas a escala de la UE y nacionales, donde se establece un Comité Europeo de IA, el cual facilitará la aplicación del reglamento y asesorará en los conocimientos especializados a la Comisión. Así mismo, determina cuáles serán las sanciones y multas y, le otorga funciones a las autoridades de vigilancia del mercado para que realicen el seguimiento de vigilancia y control.

Las normas se aplicarán principalmente a los usuarios y los proveedores que pongan en servicio sistemas de IA en la Unión, con independencia de que dichos proveedores estén establecidos en la región o en un tercer país. Al igual, los proveedores o usuarios de sistemas de IA que se encuentren en un tercer país, cuando la información de salida generada por el sistema se utilice en la Unión, con el fin de evitar la elusión del reglamento. No se aplicará para los sistemas usados exclusivamente con fines militares, a las autoridades de un tercer país o las internacionales.

MODIFICACIONES Y PROCESO DE CREACIÓN

El 25 de noviembre del 2022 el Consejo de la UE adoptó su posición común sobre la ley de la IA, que hace pequeñas modificaciones a la propuesta inicial. En cuanto a la definición de los sistemas de IA, le suprimió el anexo I y el correspondiente poder de la Comisión en la actualización y, en cambio se le añadió los considerandos 6bis y 6ter para aclarar los siguientes conceptos: “estrategia de aprendizaje automático” y “estrategias basadas en la lógica y el conocimiento”.

Las prácticas prohibidas fueron ampliadas a los agentes privados para que no puedan utilizar la IA con fines de puntuación ciudadana. Amplio la prohibición de las prácticas que se aprovechan de grupos vulnerables por su situación social o económica. De igual forma, modifico la lista (Anexo III), para prever la posibilidad de añadir nuevos supuestos de alto riesgo mediante actos delegados o que también se puedan suprimir. En cuanto al ámbito de aplicación, se crean nuevas exclusiones. Serán excluidos los casos en que los sistemas de IA sean usados con fines de investigación o con fines no profesionales, sin afectar las obligaciones de transparencia.

Por otro lado, el 14 de junio del 2023 el Parlamento Europeo adopta su posición negociadora sobre el AI Act, con 499 votos a favor, 28 en contra y 93 abstenciones. En ella, realizó importantes cambios a la propuesta inicial, el más importante está relacionado con la definición de sistemas de IA, ya que la modifica y la adapta a la definición acordada por la OCDE[6].Del mismo modo, cambia sustancialmente la lista de los sistemas de IA prohibidos. En ella incorpora la identificación biométrica tanto en tiempo real como ex post (con ciertas excepciones); los sistemas de categorización biométrica que utilice rasgos sensibles; los sistemas de actuación policial predictiva; los sistemas de IA de reconocimiento de emociones; entre otros tantos.

En cuanto a los sistemas de IA de uso general el parlamento propone un enfoque por niveles, en los que se les imponga a los proveedores de modelos funcionales la obligación de establecer una protección de los derechos fundamentales. También se les exigirá cumplir requisitos en materia de diseño, información y medio ambiente, como el registro en la base de datos. Para los grandes modelos de lenguaje (como ChatGPT) se crearon obligaciones muy estrictas al rededor del respeto por los derechos de autor.

El impacto de la IA en la sociedad ha sido considerable. Diversos sectores, incluidas las comisiones de la UE y los países miembros, han llevado a cabo exhaustivos análisis de los estudios sobre sus posibles repercusiones. Además, se han debatido y regulado diversos aspectos relacionados con este proyecto. La última novedad relevante en el proceso legislativo ocurrió el 9 de diciembre de 2023, cuando tanto el Parlamento como el Consejo de la UE llegaron a un acuerdo provisional sobre la ley. Ahora, se están llevando a cabo trabajos técnicos para afinar los detalles finales del nuevo reglamento, que luego será sometido al referéndum de los representantes de los Estados miembros.

La sociedad en general sigue sumida en la incertidumbre respecto a los efectos de la «Ley de Inteligencia Artificial». Algunos la contemplan con optimismo, considerándola una oportunidad para impulsar la innovación y fortalecer la confianza en las nuevas tecnologías. Sin embargo, otros la critican por su carácter restrictivo o su ambigüedad. Lo cierto es que esta ley es revolucionaria al ser pionera en su género.

BIBLIOGRAFÍA:

- Benj, E. 30 de noviembre del 2023. Año uno de ChatGPT: así ha cambiado el mundo desde la llegada del chatbot de OpenAI. Wired. Disponible en: https://es.wired.com/articulos/ano-uno-de-chatgpt-asi-ha-cambiado-el-mundo-desde-la-llegada-del-chatbot-de-openai#:~:text=Hoy%20hace%20un%20a%C3%B1o%2C%20el,en%20tan%20solo%20un%20a%C3%B1o

- DataScientest. 10 de agoto 2023. Inteligencia artificial: definición, historia, usos, peligros. Disponible en: https://datascientest.com/es/inteligencia-artificial-definicion#:~:text=La%20historia%20de%20la%20inteligencia%20artificial%20comenz%C3%B3%20en%201943%20con,Warren%20McCullough%20y%20Walter%20Pitts.

- Madiega, T. Junio del 2023. Artificial intelligence Act. EU Legislation in Progress. European Parliament.

- Comisión Europea. Reglamento del Parlamento Europeo y del Consejo por el que se Establecen Normas Armonizadas en Materia de Inteligencia Artificial (Ley de Inteligencia Artificial) y se Modifican Determinados Actos Legislativos de la Unión. 21 de abril del 2021. (Unión Europea)

- Consejo de la Unión Europea. Propuesta de Reglamento del Parlamento Europeo y del Consejo por el que se establecen normas armonizadas en materia de inteligencia artificial (Reglamento de Inteligencia Artificial) y se modifican determinados actos legislativos de la Unión – Orientación general. 25 de noviembre del 2022 (Unión Europea)

- Madiega, T. Junio de 2023. Posición negociadora del Parlamento sobre la Ley de Inteligencia Artificial. Parlamento Europeo.

- Noticias Parlamento Europeo. 12 de junio de 2023. Ley de IA de la UE: primera normativa sobre inteligencia artificial. Parlamento Europeo. Disponible en: Ley de IA de la UE: primera normativa sobre inteligencia artificial | Noticias | Parlamento Europeo (europa.eu)

- Consejo de la UE – Comunicado de Prensa. 9 de diciembre del 2023. Reglamento de Inteligencia Artificial: el Consejo y el Parlamento alcanzan un acuerdo sobre las primeras normas del mundo en materia de inteligencia artificial. Consejo de la Unión Europea. Disponible en: Reglamento de Inteligencia Artificial: el Consejo y el Parlamento alcanzan un acuerdo sobre las primeras normas del mundo en materia de inteligencia artificial – Consilium (europa.eu)

[1] DataScientest. 10 de agoto 2023. Inteligencia artificial: definición, historia, usos, peligros.

[2] Benj, E. 30 de noviembre del 2023. Año uno de ChatGPT: así ha cambiado el mundo desde la llegada del chatbot de OpenAI. Wired.

[3] Parte extraída de la exposición de motivos de la “IA ACT” o de la normativa: Comisión Europea. 21 de abril de 2021. Reglamento del Parlamento Europeo y del Consejo Por el que se Establecen Normas Armonizadas en la Materia de Inteligencia Artificial (Ley de Inteligencia Artificial) y se Modifican Determinados Actos Legislativos de la Unión. Bruselas

[4] Para más información véase: 20 de octubre del 2020. Resolución del Parlamento Europeo, de 20 de octubre de 2020, con recomendaciones destinadas a la Comisión sobre un marco de los aspectos éticos de la inteligencia artificial, la robótica y las tecnologías conexas. Parlamento europeo. Unión Europea. Enlace [ https://www.europarl.europa.eu/doceo/document/TA-9-2020-0275_ES.html#title1]

[5] Comisión Europea. 21 de abril de 2021. Op. Cit

[6] Definición establecida en la “Recomendación del Consejo sobre Inteligencia Artificial” adoptada por la OCDE el 21 de mayo del 2019.